- 店长推荐

-

¥143.00

-

¥78.00

-

¥55.00

-

¥69.00

-

¥80.00

-

¥42.00

- 热销商品

- 热门关注

-

热销:334 册

¥140.00

-

热销:280 册

¥37.00

-

热销:166 册

¥53.00

-

热销:151 册

¥67.00

-

热销:116 册

¥60.00

-

热销:113 册

¥100.90

-

热销:110 册

¥45.00

-

热销:108 册

¥65.00

-

热销:87 册

¥40.00

-

热销:76 册

¥123.00

-

热销:75 本

¥168.00

-

热销:74 册

¥45.00

-

1 人关注

¥34.20

-

1 人关注

¥79.93

-

1 人关注

¥69.00

-

1 人关注

¥135.36

-

1 人关注

¥28.80

-

1 人关注

¥462.00

-

0 人关注

¥123.00

-

0 人关注

¥128.00

-

0 人关注

¥43.20

-

0 人关注

¥70.00

-

0 人关注

¥58.00

-

0 人关注

¥120.00

- 商品介绍

- 商品评价

- 商品编号 -

- 品牌 弘德网

- 出版年份 2020

弘德网图书城

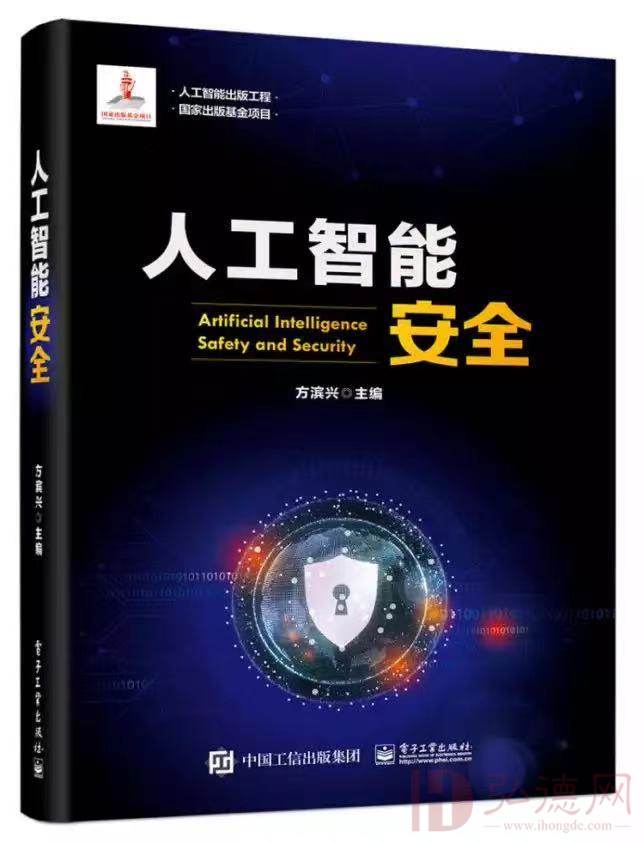

本书在简要介绍人工智能发展历程、世界各国人工智能战略规划之后,重点围绕人工智能安全主题,提出人工智能安全体系架构,讨论了人工智能助力安全、人工智能内生安全、人工智能衍生安全等相关内容,并深入研究了人工智能安全伦理准则。本书还详细分析了人工智能行为体及其可能引发的安全问题,提出了人工智能保险箍的解决方案,并给出了人工智能行为体的安全评估与检测方法。本书*后还探讨了人工智能的前沿技术,以及人工智能安全的未来发展趋势。

本书适合人工智能及安全领域的研究人员、管理人员以及广大爱好者阅读。

编辑推荐:

人工智能的安全性是当今人们广泛关注的热点话题。人们在享受人工智能技术给生活带来各种便利的同时,无时无刻不在担心人工智能技术可能会带来的各种风险。

本书就为读者答疑解惑,全方面、多视角地深入剖析人工智能安全这一主题,内容丰富精彩。

本书由中国工程院院士方滨兴亲自主编,作者格局大、站位高,具有强烈的使命感、责任感,以全方位、多学科的研究方法,开创性地诠释了人工智能安全主题,使本书具有创新性、前瞻性、实用性。

方滨兴,中国工程院院士,中国电子信息产业集团有限公司首席科学家,广州大学网络空间先进技术研究院名誉院长,哈尔滨工业大学(深圳)计算机学院首席学术顾问,信息内容安全技术国家工程实验室主任;国务院学位委员会网络空间安全一级学科评议组召集人,***网络空间安全专业教学指导委员会副主任委员;目前担任中国中文信息学会理事长、中国标准化协会网络与信息安全技术委员会主席、中国网络空间安全人才教育论坛理事长、中国网络空间新兴技术安全创新论坛理事长。曾任北京邮电大学校长、国家计算机网络应急处理技术协调中心主任、中国网络空间安全协会首任理事长;也先后担任过中国互联网协会、中国通信学会、中国计算机学会副理事长。先后获得国家科技进步一、二等奖六次,省部级奖十余次,完成著作五本,文章四百余篇。目前主要从事社交网络、网络靶场、网络空间新技术安全(如云安全)等研究工作,同时从事网络空间安全人才教育方面的工作,并创建了“方滨兴研究生班”。

本书适合高校教师、研究人员、研究生、高年级本科生 以及对人工智能安全感谢兴趣的读者使用。

第1章人工智能技术发展概述

1.1人工智能的研究方向及起源

1.1.1人工智能的研究方向

1.1.2人工智能起源

1.2人工智能的三次发展高峰

1.2.1人工智能**次发展高峰

1.2.2人工智能第二次发展高峰

1.2.3人工智能第三次发展高峰

1.3人工智能的三个学术流派

1.3.1符号主义

1.3.2连接主义

1.3.3行为主义

1.3.4关于三个学术流派的评论

1.4人工智能第三次发展高峰的技术推手

1.4.1深度学习的贡献

1.4.2软件框架成为人工智能应用的推手

1.4.3解决不同软硬件的适配

1.4.4算力大幅提升的贡献

1.4.5大数据的贡献

1.4.6移动互联网与传感器的贡献

1.5人工智能带来的巨大冲击

1.5.1人工智能对经济的冲击

1.5.2人工智能对社会的冲击

1.5.3人工智能对人类思维的冲击

1.5.4人工智能对教育与就业的影响

1.5.5人工智能对隐私的冲击

1.6本章小结

参考文献

第2章世界各国人工智能发展战略规划

2.1美国人工智能发展战略

2.1.1美国人工智能发展职能机构

2.1.2美国人工智能战略规划

2.1.3美国人工智能发展计划

2.1.4美国人工智能监管政策

2.2欧盟及英国人工智能发展战略

2.2.1欧盟及英国的人工智能战略

2.2.2欧盟人工智能发展计划

2.2.3欧盟及英国的人工智能伦理原则

2.2.4欧盟及英国人工智能立法及监管

2.3其他一些国家人工智能发展战略

2.3.1日本人工智能发展战略

2.3.2俄罗斯人工智能发展战略

2.3.3韩国、新加坡、加拿大、印度等国的人工智能战略

2.4中国人工智能发展战略

2.4.1中国人工智能发展的总体要求

2.4.2中国人工智能发展的主要任务

2.4.3中国人工智能产业发展的资源配置

2.4.4中国人工智能发展的保障措施

2.4.5中国人工智能发展的组织保障

2.4.6中国人工智能人才培养政策

2.5国内外人工智能标准研究

2.5.1国际人工智能标准研究

2.5.2中国人工智能标准研究

2.6本章小结

参考文献

第3章人工智能安全概述

3.1人工智能与安全的辩证关系

3.2人工智能安全体系架构与分类

3.2.1人工智能安全体系架构

3.2.2人工智能助力安全

3.2.3人工智能内生安全

3.2.4人工智能衍生安全

3.3人工智能安全所处位置及外部关联

3.3.1人工智能安全性、可靠性和可控性的关系

3.3.2人工智能安全与法律、政策和标准的关系

3.3.3人工智能安全与伦理之间的关系

3.3.4人工智能安全评测与防控

3.4本章小结

参考文献

第4章人工智能助力安全

4.1人工智能助力安全概述

4.2人工智能助力防御

4.2.1物理智能安防监控

4.2.2军用机器人

4.2.3智能入侵检测

4.2.4恶意代码检测与分类

4.2.5基于知识图谱的威胁猎杀

4.2.6用户实体行为分析

4.2.7垃圾邮件检测

4.3人工智能助力攻击

4.3.1自动化网络攻击

4.3.2助力网络攻击,提升网络攻击效率

4.3.3助力有害信息的传播

4.3.4助力虚假信息内容的制作

4.3.5智能恶意代码

4.3.6神经网络后门

4.3.7对抗机器学习

4.3.8智能工具被用于恶意攻击

4.3.9助力自主武器研发

4.4本章小结

参考文献

第5章人工智能的内生安全

5.1数据安全

5.1.1数据集质量影响人工智能内生安全

5.1.2数据投毒可人为导致人工智能算法出错

5.1.3对抗样本成为人工智能内生安全的新关注点

5.2框架安全

5.3算法安全

5.3.1算法的可解释性

5.3.2对抗样本体现出人工智能算法缺乏可解释性

5.4模型安全

5.4.1模型存储和管理的安全

5.4.2开源模型被攻击

5.5运行安全

5.5.1客观原因导致的运行安全问题

5.5.2主观原因导致的运行安全问题

5.6本章小结

参考文献

第6章人工智能衍生安全问题

6.1人工智能系统失误而引发的安全事故

6.1.1自动驾驶汽车失效

6.1.2智能机器人失效

6.1.3智能音箱失效

6.1.4人工智能系统“失控”

6.1.5会话人工智能的偏激言论

6.1.6医疗人工智能的危险治疗意见

6.2人工智能武器研发可能引发国际军备竞赛

6.2.1各国人工智能武器化发展情况

6.2.2人工智能武器军备竞赛带来的风险

6.3人们对人工智能技术失控的担忧

6.4人工智能行为体失控三要素

6.4.1人工智能行为体具有行为能力以及破坏力

6.4.2人工智能行为体具有不可解释的决策能力

6.4.3人工智能行为体具有进化能力,可进化成自主系统

6.5预防人工智能技术失控的举措

6.5.1人机协作国际规范

6.5.2阿西洛马人工智能原则

6.5.3自我终结机制防范系统性失控风险

6.6本章小结

参考文献

第7章人工智能行为体

7.1人工智能行为体的定义

7.2人工智能行为体类型1——传统型

7.2.1工业机器人

7.2.2专用服务机器人

7.2.3家用型机器人

7.3人工智能行为体类型2——自动驾驶的交通工具

7.3.1自动驾驶简介

7.3.2自动驾驶汽车

7.3.3人工智能无人机

7.3.4无人驾驶船舶

7.4人工智能行为体类型3——人工智能武器

7.4.1人工智能武器简介

7.4.2“杀人蜂” 武器

7.4.3炮塔型AI战斗机器人

7.4.4人形战斗机器人

7.5人工智能行为体类型4——类人机器人

7.5.1Jules机器人

7.5.2Bina48机器人

7.5.3Sophia机器人

7.6人工智能行为体的特性

7.6.1人工智能行为体的移动特性

7.6.2人工智能行为体的决策特性

7.6.3人工智能行为体的自主特性

7.7本章小结

参考文献

第8章人工智能行为体保险箍

8.1体系架构

8.2基本功能

8.2.1远程控制组件

8.2.2能源控制组件

8.2.3宿主交互组件

8.2.4数据记录组件

8.3安全机制

8.3.1设备安全

8.3.2数据安全

8.3.3运行安全

8.4安全围栏

8.4.1工作过程

8.4.2移动范围限制

8.4.3速度与距离监控

8.4.4输出功率与力约束

8.4.5安全策略

8.5增强功能

8.5.1内置传感器

8.5.2人的识别

8.5.3“黑AIA”识别

8.6防控中心

8.6.1态势感知

8.6.2指挥控制

8.6.3应急处置

8.6.4专家研判

8.7生态环境

8.7.1准入制度

8.7.2标准规范

8.7.3生态基础

8.8本章小结

参考文献

第9章人工智能行为体的安全评估与检测

9.1人工智能行为体的安全管理概述

9.1.1从术语的角度感受个人助理机器人的安全要素

9.1.2个人助理机器人的风险评估要求

9.1.3个人助理机器人的安全要求

9.1.4个人助理机器人的功能安全

9.2人工智能行为体安全评估和检测的目标

9.2.1动能安全:对AIA动能的评估

9.2.2决策安全:对决策系统安全的评估

9.2.3自主安全:对AIA自主能力失控风险的评估

9.3人工智能行为体安全评估的方法与指标

9.3.1动能安全评估

9.3.2决策安全评估

9.3.3自主安全评估

9.3.4安全评估过程

9.4人工智能行为体检测能力与检测方法

9.4.1针对AIA动能的检测方法

9.4.2针对AIA决策机制的检测方法

9.4.3针对AIA自主能力的检测方法

9.5人工智能行为体的检测流程

9.5.1针对AIA动能的检测流程

9.5.2针对AIA决策机制的检测流程

9.5.3针对AIA自主能力的检测流程

9.6本章小结

参考文献

第10章人工智能安全伦理准则

10.1人工智能技术引发的伦理问题

10.1.1人权问题

10.1.2伦理地位问题

10.1.3责任伦理问题

10.1.4风险问题

10.2人工智能技术发展的伦理准则

10.2.1各国政府及社团组织关于人工智能技术发展的伦理准则

10.2.2国际组织关于人工智能技术发展的伦理准则

10.2.3企业和高等院校关于人工智能技术发展的伦理准则

10.3人工智能行为体的伦理决策

10.3.1人工智能行为体的伦理决策能力

10.3.2人工智能行为体的伦理决策设计

10.3.3人工智能行为体的伦理决策考量

10.4人工智能行为体的责任归咎

10.4.1责任主体

10.4.2责任分配

10.4.3无人驾驶汽车的责任追究

10.5本章小结

参考文献

第11章人工智能前沿技术

11.1学术前沿

11.1.1强化学习

11.1.2迁移学习

11.1.3联邦学习

11.1.4分布式机器学习

11.1.5表示学习

11.1.6元学习

11.1.7可解释的人工智能

11.1.8对抗训练

11.1.9人工智能芯片

11.1.10技术前沿安全挑战

11.2应用前沿

11.2.1计算机视觉

11.2.2自然语言处理

11.2.3智能语音

11.2.4智能驾驶

11.2.5拟人和仿生

11.2.6智能攻防

11.2.7应用前沿安全挑战

11.3交叉领域

11.3.1人工智能与互联网

11.3.2人工智能与工业互联网

11.3.3人工智能与医学生物

11.3.4人工智能与军事

11.3.5人工智能与商业模式

11.3.6人工智能与人文社会

11.3.7交叉领域安全挑战

11.4本章小结

参考文献

第12章人工智能安全的未来展望

12.1人工智能内生安全的未来展望

12.1.1数据是否会制约人工智能内生安全

12.1.2对抗样本是否会出现在实际应用场景中

12.1.3是否存在安全的智能模型

12.1.4人工智能执行过程是否安全

12.2人工智能衍生安全的未来展望

12.2.1人工智能武器化

12.2.2人工智能滥用导致安全隐患

12.2.3人工智能是否会危害人类

12.3人工智能安全相关的未来焦点

12.3.1人工智能基础工具应注重自主可控

12.3.2如何看待人工智能自主发明物的专利性问题

12.3.3人工智能对人的影响

12.3.4人工智能挑起的欲望

12.3.5超人工智能是否会危害人类

12.4人工智能的安全可控之路

12.4.1建立保护人类的法律规范和规章制度

12.4.2确立人类优先与安全优先的原则

12.4.3谨慎承认智能机器人的法律主体资格

12.4.4充分尊重社会公众的知情权

12.4.5人工智能的安全评估与检测

12.4.6人工智能安全可控需要社会各界共同的努力

12.5本章小结

参考文献

- 全部评价

- 晒图

- 追评

- 好评

- 中评

- 差评

![电磁应用极简史,电磁频谱基础特性,电磁环境演进史,电磁频谱管理

出版社:国防工业出版社 郭兰图[等]著 ISBN:978711813028-7](https://img.ihongde.com/shop/1146/product/R7pwSYS7YD.jpg?x-oss-process=image/resize,m_lfit,w_320,h_320,image/auto-orient,1/quality,q_90/watermark,image_YXNzZXRzL2RlZmF1bHQvd20ucG5nP3gtb3NzLXByb2Nlc3M9aW1hZ2UvcmVzaXplLFBfMzU,g_se,t_22,x_10,y_10)