【第三期】技术进步,骗子先用?我用V7000为您检测深度伪造视频!弘德网_弘德商城_公共安全产品网

从ChatGPT所代表的生成式AI而起,越来越多的人对于其双刃剑效用感到担忧。如今,这一担忧似乎正被不断出现的案例所验证。

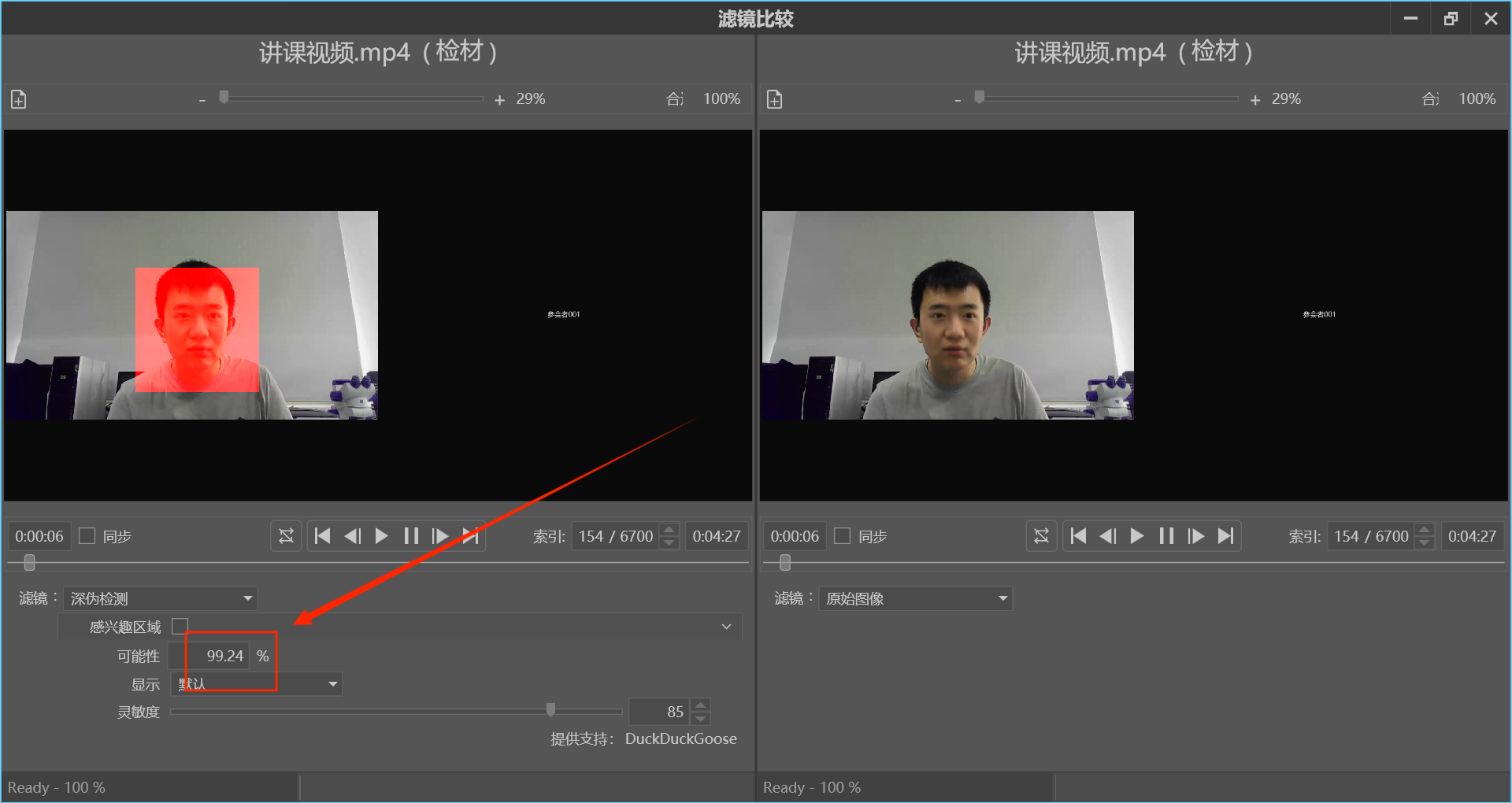

今天灿灿为大家提供一段用德皓V7000视频图像鉴真系统实录的视频,看它在检测深度伪造视频方面的功能表现。

下面进入我们的正文吧

AI技术的双刃剑

近日,内蒙某地警方发布一起利用人工智能(AI)实施电信诈骗的典型案例:某科技公司法人代表郭先生10分钟内被骗430万元。

郭先生的好友通过微信视频联系到他,自己在外地竞标,需要公对公转账430万保证金,想要借郭先生公司的账户走账。基于对好友的信任,加之已经视频聊天核实了身份,郭先生没有核实钱款是否到账,就分两笔把430万转到了好友朋友的银行卡上。

技术进步,骗子先用

或许是一种规律:对于某项新兴技术,骗子基于牟利需求,总是比普通人具有更灵敏的嗅觉。“AI换脸”技术已经多次出现,人们只需提供一张照片,经深度合成算法处理,就能秒变视频主人公。当时不少人将其作为消遣和乐趣。

如今回想起来,这些人脸信息如果没有得到妥善处理,极易流向未知领域。或许就在明天,你的脸出现在另一个人身上,用于向你的微信好友寻求资金帮助。

VDEC 668 智鉴影像真伪

面对AI滥用,传统的视频通话验证手段面临失灵。通过什么样的技术手段,人类才能避免退回10年前的沟通方式,凡事都得当面谈?VDEC 668 影像鉴真系统,除了常规的ELA、DCT、CFA等传统检测方式外,VDEC 668还支持深伪检测,涵盖7大类主流神经网络算法,自动检测视频中存在的人脸,并给出人脸的疑似篡改指标,支持通过调节参数显示检测结果细节。

(注意:目前的深伪检测技术,同样基于人工智能技术和对抗神经网络算法,基于训练库形成结论。因此具有检测提示作用,但不能单独作为变造检验的最终结论。)

个人防范,避免上当

作为普通民众,每次使用专业设备进行鉴定似乎不太现实。那么个人在日常生活中又该做到哪些呢?

保护隐私信息

●不轻易提供人脸、指纹等个人生物信息给他人,不过度公开或分享动图、视频等。

●陌生链接不要点,陌生软件不要下载,陌生好友不要随便加,防止手机、电脑中病毒,微信、QQ等被盗号。

提高安全意识

●公检法没有安全账户,警察不会网上办案,如果有网络警察说你犯事了,让他联系你当地的派出所,你也可以主动打110咨询。

●如不慎被骗或遇可疑情形,请注意保护证据立即拨打110报警。

希望随着个人防范的加强、法律法规的完善、检测技术的进步,AI技术能渐渐走向成熟,真正让大众感知到AI技术的美好。

*文章部分内容引用其他(自)媒体文章,如有侵权请联系弘德网,我们将及时删除。